在AI技术飞速发展的今天,如何让模型输出更精准、更稳定,成为开发者和创作者共同的挑战。Prompt Optimizer作为一款创新的开源跨平台AI提示词优化工具,正以其独特优势,赋能各类AI应用,尤其在激活小模型潜力、保障生产稳定性及激发创意灵感方面,展现出卓越性能。它支持Web、桌面、Chrome插件及Docker部署,提供一键优化、对比测试及多模型集成等强大功能,旨在全面提升AI输出质量。

揭秘Prompt Optimizer:赋能AI创作与开发的核心利器

Prompt Optimizer是一款由开发者精心打造的AI提示词优化工具,其核心目标是确保任何规模的AI模型,即使是资源受限的小模型,也能通过高质量的提示词,输出稳定且可控的结果。它通过智能重构与优化提示词,有效提升AI的理解力和执行力,让模型不再“跑偏”,而是精准响应用户需求。

优化小模型潜力,降低AI成本

许多企业和个人在AI应用中,面临模型成本高昂的困境。Prompt Optimizer通过结构化提示词,能够显著提升小模型的性能表现,使其在特定任务中达到接近大型模型的输出水准。这不仅有助于降低AI部署和运行的成本,也为资源有限的团队提供了高效的解决方案,让AI技术更加触手可及。

提升生产稳定性,保障业务流程

在生产环境中,AI模型的稳定性至关重要。Prompt Optimizer能够帮助用户生成更加清晰、明确的提示词,从而减少模型理解偏差,提高输出的准确性和一致性。尤其在知识图谱提取等场景,它能快速抽取结构化数据,降低模型智能门槛,有效提升业务流程的稳定性和可靠性。

激发创意灵感,共创独特作品

对于诗歌、创意写作等领域,Prompt Optimizer同样表现出色。它能将模糊的灵感拆解为具体的元素,如意象、情感、主题等,帮助用户与AI共同创作出独具风格的艺术作品。通过精细化提示词,AI不再是简单的工具,而是成为创作者的得力助手,共同探索无限创意可能。

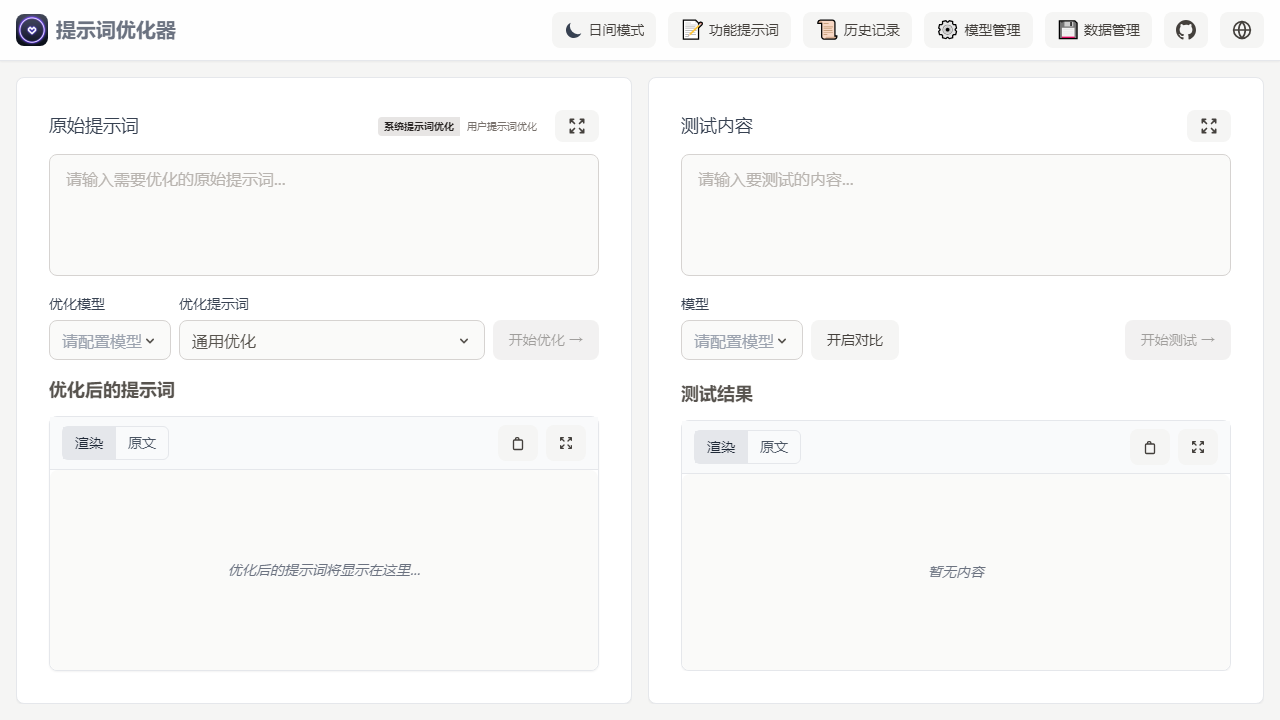

Prompt Optimizer核心功能与多端部署优势

Prompt Optimizer凭借其强大的核心特性和灵活的多端部署方案,成为AI提示词优化领域的佼佼者。它不仅提供了智能化的优化功能,更在安全性和便捷性上做到了极致,满足了不同用户的多样化需求。

智能优化:一键提升AI回复准确度

Prompt Optimizer提供智能优化功能,支持一键重写提示词,并允许用户进行多轮迭代。通过系统提示与用户提示的双模式优化,它能灵活适配各种任务场景,显著提升AI回复的准确度和相关性。无论是复杂的编程任务还是日常的对话交流,都能获得更满意的结果。

实时对比与多模型集成

为了让用户直观感受优化效果,Prompt Optimizer支持原始与优化后提示词的实时对比,一屏对照,效果立竿见影。此外,它还兼容OpenAI、Gemini、DeepSeek、智谱AI、SiliconFlow等主流AI模型,甚至支持本地部署模型,为用户提供了极大的灵活性和选择空间。

极致安全与隐私保护

Prompt Optimizer在设计之初就将安全与隐私放在首位。它采用纯客户端运行架构,所有提示与结果均在本地处理,数据直接与AI服务商交互,无中转服务器。这意味着用户数据不会经过任何第三方存储,大大降低了泄露风险。私有化部署时,还可启用密码保护,进一步控制访问权限。

多端部署:满足多样化工作流

Prompt Optimizer提供多种部署方式,满足不同用户的工作流需求:

- 线上即用: 直接访问官方站点,所有数据保存在浏览器本地,无需注册,兼顾便捷与隐私。

- Chrome插件: 商店提供官方扩展,选中文本即可一键生成优化提示,提升工作效率。

- 桌面客户端: Electron桌面应用免去浏览器跨域限制,内置自动更新机制,适合对性能和长期维护有要求的用户。

- 私有化部署: 支持Docker部署,只需简单命令即可快速上线,也支持Compose与国内镜像,方便企业或个人进行定制化部署。Vercel一键部署功能,让开发者能轻松Fork仓库并导入,快速搭建专属优化平台。

立即体验Prompt Optimizer,开启AI提示词优化新纪元

Prompt Optimizer以其开源、离线、安全的特性,以及对多模型的广泛支持,已成为中文社区中最活跃、最易用的提示词优化方案之一。它不仅为模型降本增效打开了新思路,也为创作者提供了强大的定制工具。

无论是AI开发者寻求生产稳定性,还是内容创作者追求极致灵感,Prompt Optimizer都能成为您不可或缺的AI助手。立即访问线上体验地址,或前往GitHub获取项目源码,亲身体验Prompt Optimizer带来的变革吧!让您的AI模型发挥最大潜力,轻松应对各种挑战。